3月28日,

#女子地铁照被AI一键脱衣传播#

冲上热搜,引发网友关注。

事实上,这张裸体照并非真实照片

而是被AI技术一键脱衣生成的……

据报道,近日,广东广州,一女子在地铁上的照片被AI一键脱衣,造谣图在网络广泛传播引发关注。

事实上,照片的女主角是小红书的一名博主,而所谓的“裸照”则是她去年7月在平台分享的一张照片。原图中她衣着正常,完全没有任何不妥之处,但却被有心之人用AI软件一键脱衣,故意全网散播。

目前博主已在评论区回复各位网友,称会进行相关的维权处理。

在这则图文分享的评论区,已经有众多网友评论提醒博主被造谣的事实,催促其尽快报警,也有人热心地帮助其辟谣澄清。

死灰复燃的AI脱衣,侵权无下限

在AI技术萌芽发展之初,深度合成、伪造功能就被心怀不轨的人盯上了。2020年,海外曾发布过一款名为deepnude的软件,该软件就可以通过AI技术实现“一键脱衣”,该软件带来的伦理问题很快引发了争议,很快就被开发商下架了。但是记者发现,国内的网络平台中竟然存在着不少有类似功能的软件,想要下载到一个也并不算困难,还有一些软件是早就被封禁的deepnude的仿版。

类似的事件发生过多次,AI图像处理技术在日新月异的变化下给美术、摄影等诸多行业带来了变革,实现了生产力的跃升,它可以说是一个好的工具,但是在别有用心的人手中,AI图像处理技术则成为满足私欲、伤害他人的另一种工具。

尽管已经有不少网友开始呼吁尽快对AI应用领域进行立法管理,但是实际上面临的问题还是相当艰巨,一张图片如何证实是AI参与制作的,如何取证,如何执行等等问题都还悬而未解。在这样的事件中,尽管网友们几乎一致认为技术无罪,有罪的是造谣者,但这些隐藏在非法网站中的软件,何尝不是推波助澜的恶之手呢?需要处理的,不仅仅是犯罪的人,这些隐藏在网络中的非法软件,也应当被看见。

无独有偶。前几天还有类似事件引发关注——

男网红高调晒“热吻女明星”影片

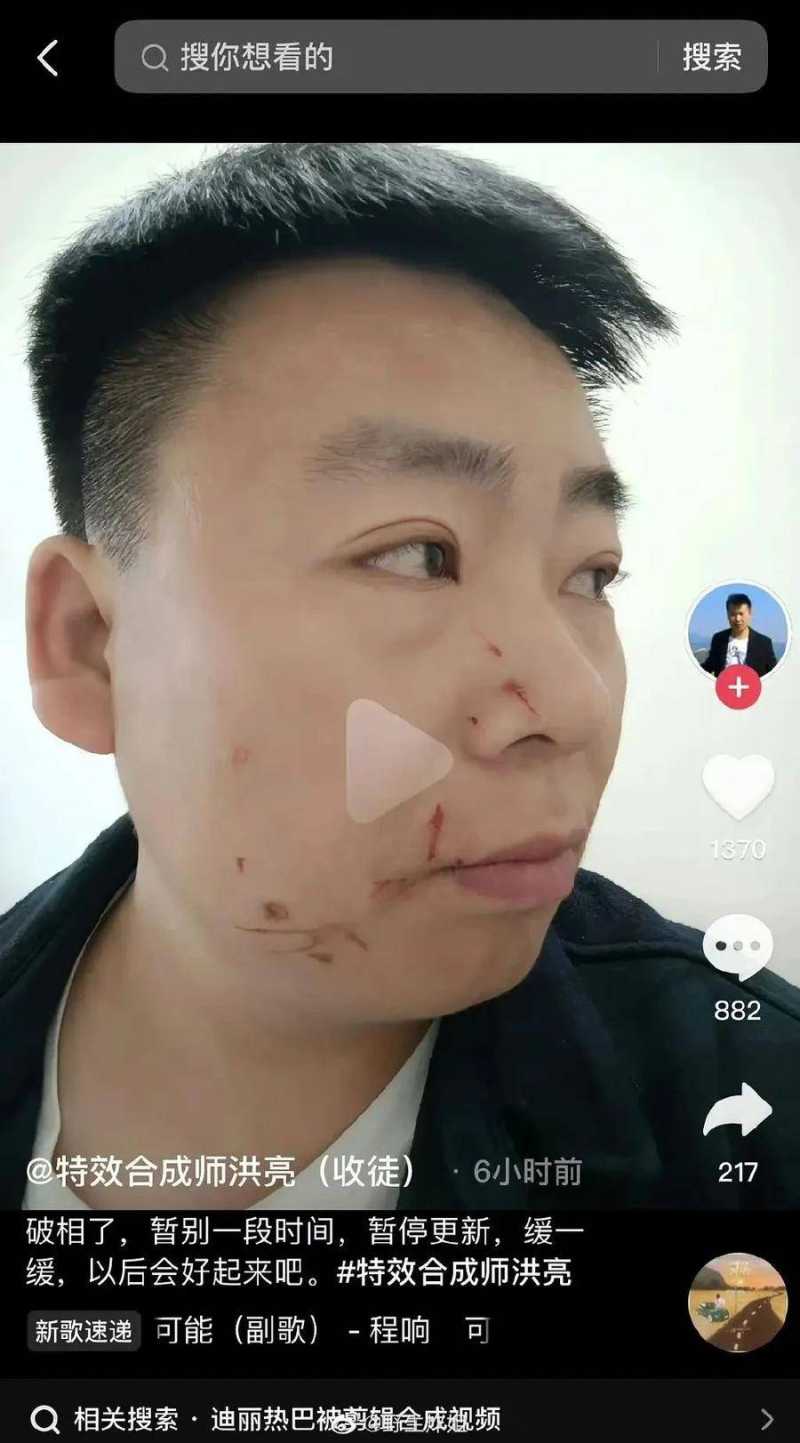

一网红特效合成师利用电脑后期制作,合成与某知名女星亲吻的影片在网上广泛传播,引发网友热议。

据悉,该特效师洪某,会在个人账号上发布一些“特效合成”的视频,大概就是把一些热门剧里的角色用“特效”的手段进行更换,把里面的男主角换成自己,把里面相关的剧情用自己的面容再演绎一遍,从而达到猎奇和博人眼球的目的。

记者发现,洪某的抖音粉丝达100多万,微博粉丝10多万,平时的作品有一定的关注度。

3月25日,洪某在社交平台上表示,自己的脸因为这件事被女演员的粉丝抓伤,“破相”了。

他在评论区里称:“某女演员粉丝,几个20多岁左右的小孩,找到我发过的定位,来我工作室门口,然后就变这样了。”

此事在网络上引发热议,很多人对此表示不满:

这种换自己脸跟女明星接吻,有点变态了吧?

这个难道不算是性骚扰的一种形式吗?

这涉及侵犯肖像权吗?

也有网友直接发问:这种行为算隔空猥亵吗?

AI换脸换装,或涉嫌刑事犯罪

近年来,“AI换脸”走红网络,一些“AI换脸”的App使用明星的图片制作换脸视频进行推广,其趣味性背后暗藏不少法律风险和侵权纠纷。

一键脱衣、换脸亲吻?每个人都可能成为AI作恶的受害者。专家表示,在《网络安全法》第二十七条的规定当中,特别强调,明知他人实施危害网络安全活动的,不能够为他提供技术支持,如果情节严重,还会构成帮助信息网络犯罪活动罪等刑事犯罪。

编辑:彭茜